本文转自公众号 机器之心

【导读】对知识工程的研究贯穿于整个人工智能的发展史。作为目前最为火热的先验知识组织、表征技术,知识图谱的相关工作在本届 ACL 上可谓万众瞩目。本文将介绍本届 ACL 收录的一些知识图谱方向的优秀成果,希望对读者们有所启发。

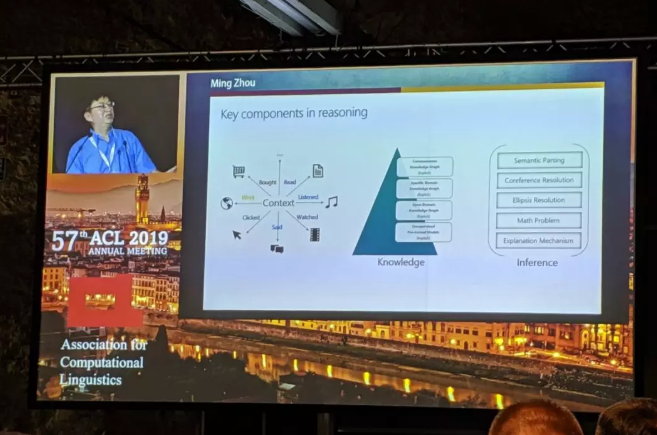

大家好,ACL 2019 刚刚结束,我在风景如画的佛罗伦萨参加了为期一周的讲座,教学课程与研讨会!在本文中,我将回顾一下知识图谱如何步步为营地融入 NLP 研究社区。

ACL 2019 盛况空前,研究者们向本届大会提交了 2900 份论文,其中的 660 份论文被接受,大会共有 3000 多名参会者,并设有 4 个研讨会,约 400 名与会者参与到这些研讨会中(研讨会规模比一些国际计算机科学会议还大)。例如,Mihail Eric 编写了一篇关于通用 ACL 趋势的精彩文章(https://www.mihaileric.com/posts/nlp-trends-acl-2019/)。除了 BERTology,transformers 和机器翻译等热门话题之外,还出现了新的趋势,例如对抗学习,自然语言生成和知识图谱(KG)。我个人非常高兴看到 KG 在顶级人工智能会议上受到了如此大的推崇:在 660 中有大约 30 篇论文,这样一个大型会议占有 5% 的比重是很不错的(好吧,ACL 不一直都是 AI 的风向标吗?)。所以,我想概括一些 KG 最具代表性的主要应用领域,并介绍一些在 ACL 期间演示的一些非常有前景的论文。由于会议的规模太大,本文很可能遗漏了一些内容。

基于知识图谱的对话系统

传统的对话系统分为目标导向型(goal-oriented)和闲聊型(chit-chat)智能体。目标导向型的对话系统可以帮助用户完成某项任务,例如在餐厅预订餐桌或协助驾驶员完成车内的任务(如果你想进一步了解典型的基于 KG 的对话系统,请参阅下面的博文:https://medium.com/deeppavlov/building-a-knowledge-graph-based-dialogue-system-at-the-2nd-convai-summer-school-ec2d0aa060e5)。闲聊型智能体是用于聊天的对话系统,具有互动性、娱乐性,很吸引人。最近,你可能听说过深度学习在没有特定工作流程的情况下,构建端到端对话智能体的工作中所取得的成就(尤其是闲聊型智能体)。然而,越来越明显的是,两种类型的智能体都必须拥有一些知识(即目标导向智能体所需领域知识,以及聊天智能体所需的更多的常识性知识)。

亚马逊的 Ruhi Sarikaya(https://sites.google.com/site/ruhisarikaya01/home)证明了:Alexa 仍然必须在流水线模式下部分执行,从结构化的源头(例如,图结构)中提取知识。

微软研究院的 Jianfeng Gao(https://www.microsoft.com/en-us/research/people/jfgao/)解释 Xiaoice 如何利用结构化信息进行用户参与(Xiaoice 仍然保持聊天机器人最长对话轮次的记录)。

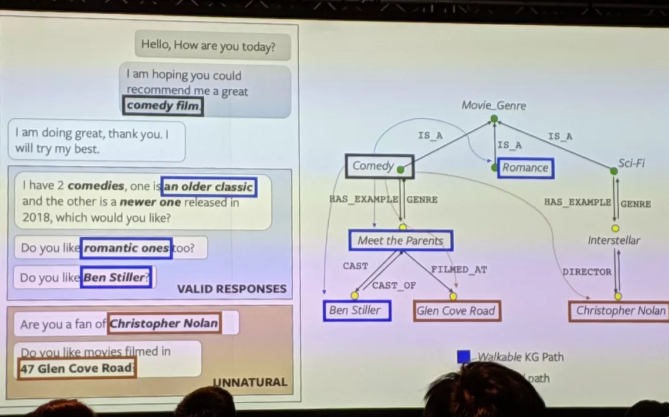

Facebook AI 的 Moon 等人于 2019 提出了 OpenDialKG (https://www.aclweb.org/anthology/P19-1081),这是一个全新的开放式对话 - 知识图谱并行语料库,包含 15,000 条带标签的对话,共有 91,000 多个对话回合,该语料库基于包含超过 1M 个三元组,100,000 个实体和 1,358 条关系的 Freebase 子集。该工作向着构建基于 KG 的对话系统迈出了一大步,希望 Facebook 的例子会鼓舞到其他人!此外,作者提出了一种新颖的“DialKG Walk”架构,通过一个基于注意力机制的图路径解码器,以一种端到端的方式利用知识图谱。

唯一令人担心的是,选用的图谱源(Freebase)自 2014 年以来就正式停用了,并且已经很久没有得到官方支持。或许,研究社区是时候转而使用维基百科数据了?

知识图谱事实的自然语言生成

生成连贯的自然语言话语(例如,根据结构化数据)也是一个热门的新兴话题。虽然纯粹的神经网络端到端自然语言生成模型试图解决产生非常枯燥的文本的问题,但基于结构化数据的自然语言生成在表达自然语言的固有结构方面面临着重大挑战。此外,知识图谱也很难用语言表达。例如,你可以根据一个三元组(柏林,是... 首都,德国)生成一堆不同的句子,但是当你有一组相关联的三元组时,例如(柏林,是... 首都,德国)、(2006 世界杯,由... 举办,德国)时,下面哪个选择更好呢?

“柏林是主办 2006 年世界杯的德国的首都”还是“柏林是举办 2006 年世界杯的国家的首都”?

令人惊讶的是,ACL 大会上有许多关于知识图谱三元组语言描述的工作。

首先,我想 IBM Research 组织的关于讲故事的研讨会(https://sites.google.com/view/acl-19-nlg/slides),该研讨会提出了许多挑战以及解决三元组语言化问题的可能方法,请务必查看幻灯片!

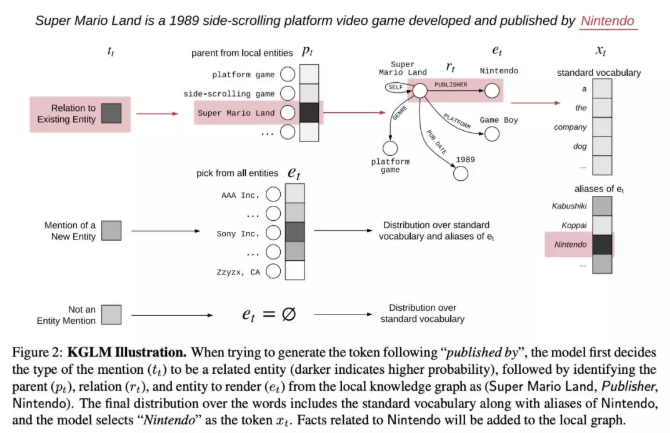

Logan 等人(https://www.aclweb.org/anthology/P19-1598)撰写的一篇很棒的论文和海报建议将 OpenAI GPT 等语言模型与知识图谱嵌入结合使用。作者还提出了一个新的数据集 Linked WikiText-2(https://rloganiv.github.io/linked-wikitext-2),其中训练部分包含超过 41,000 个实体和 1,500 对关系,并用维基数据进行了标注。

除了来自 ACL 2019 的工作,在最近的 NAACL 2019 上,Moryossef 等人(https://arxiv.org/abs/1904.03396)也提出了一项非常相关的工作“Chimera”:NLG 三元组的双层模型。首先,给定一组三元组,它们以图的形式生成文本计划,保留给定三元组的组合性,对它们进行排列,并最终运行具有复制机制的典型神经机器翻译(NMT)系统来生成文本句子。本文基于 WebNLG 数据集(https://gitlab.com/shimorina/webnlg-dataset)进行模型评估,该数据集也使用了维基数据实体和谓词 ID!

基于知识图谱的复杂问答

作为一类阅读理解任务,研究者们很喜欢使用“问答系统”来追踪大型模型(如 BERT)的最新研究进展。

“基于知识图谱(KGQA)的问答旨在为用户提供一个用自然语言提问的界面,使用他们自己的术语,通过查询 KG 得到生成的简明答案”。

我引用了 Chakraborty 等人最近发表的关于 KGQA 的综合研究,链接如下:https://arxiv.org/pdf/1907.09361.pdf。在 QA 任务中,KG 为用户提供可解释的结果(实际上,图模式能/或不能在目标图中被找到)。此外,它们可以执行阅读理解系统尚无法实现的复杂推理。ACL 2019 上有许多该领域最先进的研究,有兴趣的读者可以去看一看。

Saha 等人(https://www.mitpressjournals.org/doi/pdf/10.1162/tacl_a_00262)在复杂序列问答 CSQA(https://amritasaha1812.github.io/CSQA/)数据集(包括维基数据 ID)上展开了相关工作,该数据集涉及到目前 KG 领域最棘手的问题:

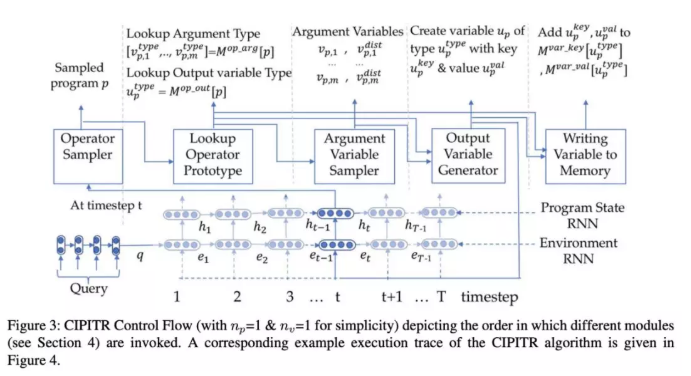

在不使用记忆单元的情况下,在简单问题上训练的方法会表现出相当差的效果,现在看来你需要某种形式化的语言或语法来执行逻辑动作和聚合。该论文的作者提出了一种包含若干动作的语法(例如,设置交集,知识图谱嵌入查找等),强化学习利用它来推导出能够在对话环境中回答那些复杂问题的逻辑程序。

Weber 等人(https://arxiv.org/pdf/1906.06187.pdf)继续研究神经 Prolog,这是一种将符号推理和基于句子嵌入的规则学习方法结合起来可微逻辑方法,可以直接应用于自然语言文本,而无需将它们转换为逻辑形式,并使用 Prolog 形式的推理来回答逻辑查询。因此,一方面,该框架建立在模糊逻辑和预训练句子嵌入模型之上。在我看来,神经逻辑方法被研究社区严重低估了。这篇论文和上面提到的论文都为它们如何推断出一个特定的答案提供了非常有根据的可解释的机制。因此,当研究者们开始追求真正的可解释性时,我希望这个领域能得到更大的支持。

针对处理更简单的 KGQA 数据集,Xiong 等人(https://www.aclweb.org/anthology/P19-1417)提出了一种基于非完全知识图谱的 QA 方法,其中需要进行一些连接预测。而 Sydorova 等人(https://www.aclweb.org/anthology/P19-1488)在具有“图”和“文本段落”两类知识源的 TextKBQA 任务上取得了很好的效果。Yang 等人(https://www.aclweb.org/anthology/P19-1226)提出了另一种通过 KG(本例中使用的是 WordNet 和 NELL)丰富与 BERT 类似的阅读理解模型的方法。截至 2019 年 3 月,他们的 KT-NET 在 SQuAD 1.1 和 ReCoRD 上的表现优于纯粹的 MRC 系统,这证明它是一种很有前景的研究方法。

基于阅读理解的 QA 系统仍旧很火,本届 ACL 上有几个专门针对该领域的口头报告和海报会议,所以我很确定会有关于该领域的详细报告。简而言之,像 WikiHop 或 HotpotQA 这样的新数据集针对整个维基百科文章进行多跳 QA,你需要结合几篇文章中的知识来回答某一个问题。CommonsenseQA 包含来自搜索引擎日志的真实问题,因此系统需要某种常识性推理。为了从一些完全无意义的案例中区分出有意义的案例,你需要进行对抗性训练,本届 ACL 上相关的工作包括来自 Zhu 等人(https://www.aclweb.org/anthology/P19-1415)和 Wu 等人(https://www.aclweb.org/anthology/P19-1616)的论文,他们的论文证明对抗训练是有效的。

最后,为了克服经常遇到的数据集较小的问题,Alberti 等人(https://www.aclweb.org/anthology/P19-1620),提出了一种“复述”的数据增强模式,产生高达 50M 额外问题用以训练他们的系统,并实现了 +2 到 +3 的 F1 值提升。

基于知识图谱的命名实体识别和关系链接

信息抽取是本届 ACL 最受关注的研究方向之一!KG 在命名实体识别,实体链接,关系抽取和关系链接任务中展示出了实实在在的优势。我对于根据文本源构建知识图谱的神经方法特别感兴趣。研究人员已经提出了许多新的数据集(使用维基数据 ID)和方法。

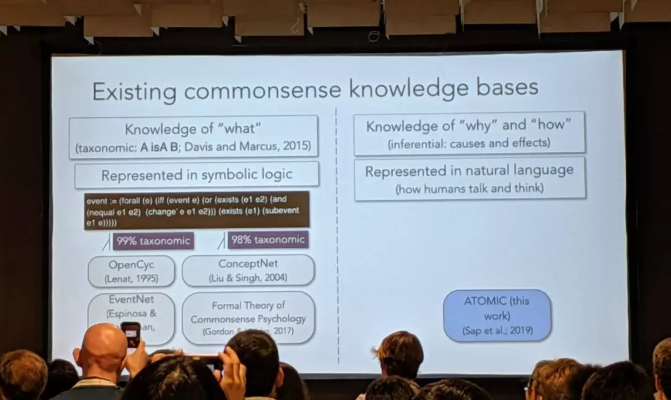

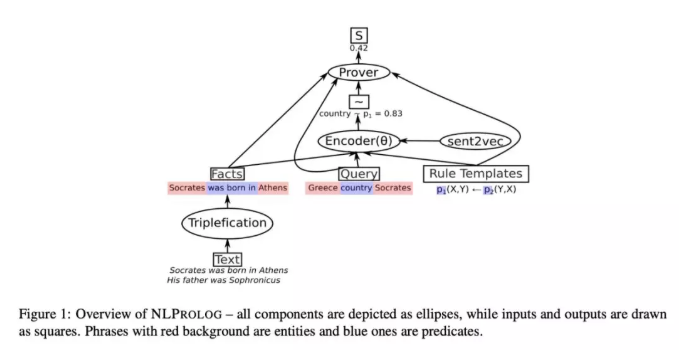

在本届 ACL 大会的论文中,Bosselut 等人的「COMET : Commonsense Transformers for Automatic Knowledge Graph Construction」(https://www.aclweb.org/anthology/P19-1470)是我最喜欢的三篇论文之一。

本文提出了 COMET 常识 Transformer 架构,作者将 GPT-2 等语言模型与 ATOMIC 等种子知识图谱相结合。向 COMET 输入图谱中的种子元组,COMET 可以学习到其结构和关系。另一方面,根据图表征形成语言模型,从而生成新的节点和边并将它们添加到种子图中。更酷的是,你可以将图表示为自然文本的元组,如(小憩一会,导致,有能量)。在维基数据等大型数据集上测试这种架构将是非常有趣的。

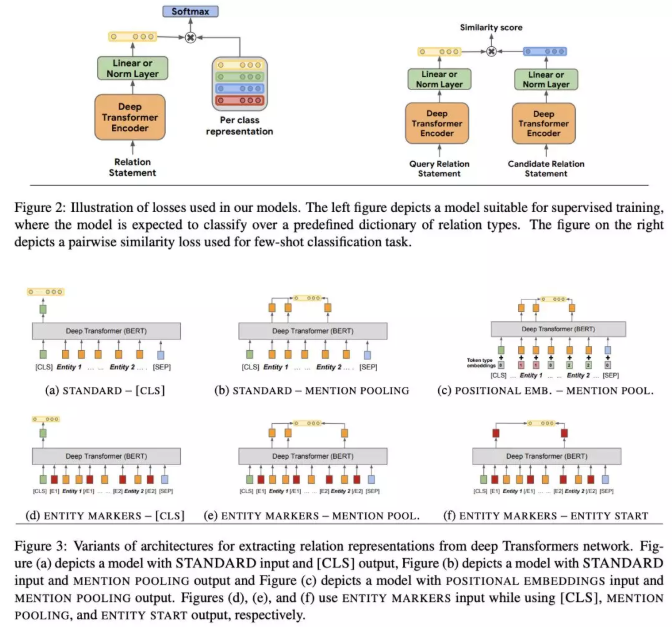

本届 ACL 还出现了一些用于关系抽取的新数据集和基线模型(基于维基数据实体和谓词)。Yao 和 Ye 等人(https://arxiv.org/pdf/1906.06127.pdf)提出了一个巨大的 DocRED 数据集,它由 6 个实体类型,96 个关系,2.5M 个实体(没有维基数据 ID),102,000 个文档中的 828,000 条句子组成。Trisedya 等人(https://www.aclweb.org/anthology/P19-1023)提出了一个包含 255,000 个“文本——三元组”对,280,000 个实体和 158 个谓词的 WIKI 数据集,其任务是从给定的自然语言句子以及该数据集的基准模型构建知识图谱。此外,Chen 等人(https://www.aclweb.org/anthology/P19-1278)提出了一个关系相似性的数据集,它由 426,000 个三元组,112,000 个实体,188 种关系组成。

Zhu 等人(https://www.aclweb.org/anthology/P19-1128)在信息抽取开展了更为深入的研究。他们利用图注意力网络在关系链接任务中得到了很好的实验结果。他们将句子中的实体和关系的组合建模为图,并使用能够识别多跳关系的多样式图神经网络(GNN)。其实验结果相较于目前最先进的方法有显著提升!

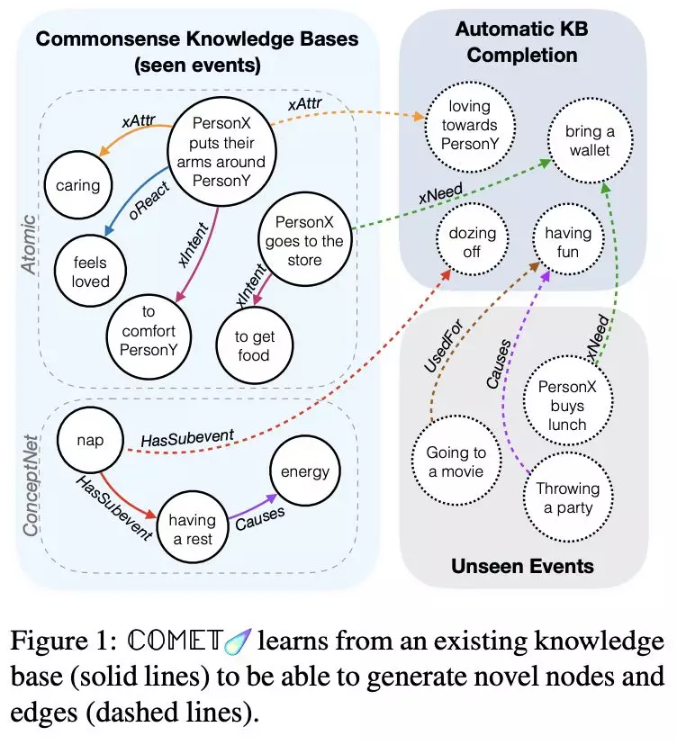

Soares 等人(https://www.aclweb.org/anthology/P19-1279)的工作描述了一种新的关系学习方法 - 像 BERT 一样预训练一个大型模型,并通过其编码器传递句子以获得关系的抽象概念,然后针对维基数据,TACRED 或 DBpedia 等特定模式调优,从而获得具有相应 ID 的实际谓词。这种方法很有意义,通常基于 KG 的信息抽取方法是针对特定的本体而定制的,所以当你有很多任务时,你就要建立很多本体。在这里,作者从任何模式中分离出一个关系,并允许提取你可能希望包含在你自己的模式中的非常通用的关系。该方法的准确率相较于之前的方法有实质性的提升(尤其是在零样本和小样本任务中),因此你可以在训练数据非常有限的情况下使用它。

在实体链接方面,Logeswaran 等人(https://www.aclweb.org/anthology/P19-1335)提出使用类似 BERT 的预训练阅读理解模型,从而泛化到到模型未见过的领域中的未见实体。为此,他们引入了领域自适应预训练(DAP)策略,以及在不可见域中进行零样本实体链接的新任务。目前,尽管数据集由 Wikia 文章组成,但我认为将框架应用于可以包含多语言标签和同义词,或定义明确的特定领域本体的知识图谱上应该没有太大的问题。

Hosseini 等人(https://www.mitpressjournals.org/doi/pdf/10.1162/tacl_a_00250)在他们的工作中,研究从自然语言文本中直接提取关系图的问题,他们在评估的数据集上取得了显著的效果。Shaw 等人(https://www.aclweb.org/anthology/P19-1010)也做了类似的工作,他们应用图网络(近来 GNN 当然非常火)来获得实体的逻辑形式。

Wu 等人(https://www.aclweb.org/anthology/P19-1616)研究了 KG 中的关系表征,并提出一种表征适配器模型,该模型能够基于现有的 KG 嵌入泛化到非种子关系上。作者还将 SimpleQuestion(SQ)数据集调整为 SimpleQuestions-Balance(SQB),使训练/测试的数据切片中见过与未见过的谓词的分布更加平衡。

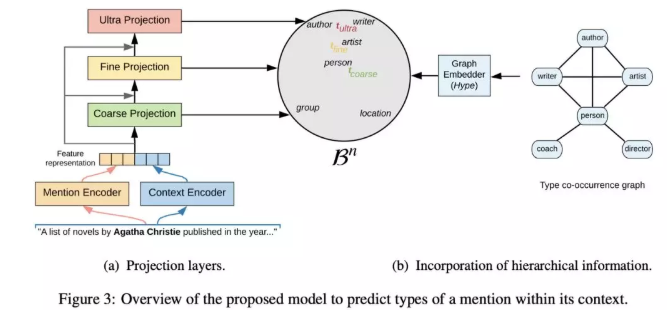

在命名实体识别(NER)方面,我想概述 Lopez 等人(https://arxiv.org/pdf/1906.02505.pdf)关于“双曲空间中的细粒度实体分类”的工作。作者使用可能涉及的实体和实体类型的二维列表(转换为具有后续图网络表征的图),构建了一个双曲嵌入空间,能够推断提及的上下文并在很大程度上指定实体类型。例如,给定一个句子“由 Agatha Christie 发表的小说列表......”,Agatha Christie 不仅会被归为人类,而且会被归为一个更细粒度的作家类。实际上,在 UltraFine 数据集上训练的框架可以被指定为三个级别!在 OntoNotes 数据集上,实验结果与目前最先进的方法相当。

KG 嵌入和图表征

也许人们会认为 NLP 会议不是了解图表征学习的最佳场所,但是放眼望去,本届 ACL 上出现了一些非常有见地的论文,它们试图同时从架构和语义两方面编码知识图谱。

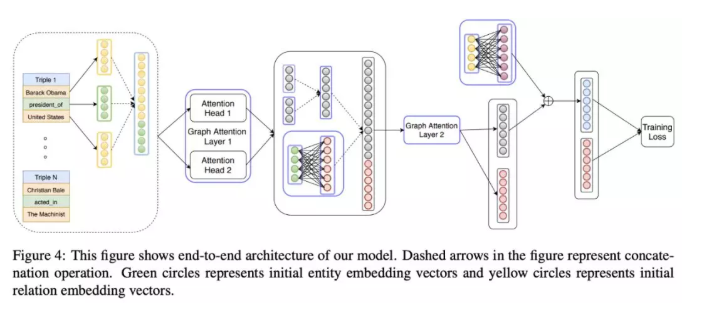

Nathani 等人(https://www.aclweb.org/anthology/P19-1466)提出了一种基于图注意力网络(GAT)的知识图谱嵌入方法,该方法考虑到了注意力机制中的节点和边的特征。作者采用多头注意力架构,并重点强调对关系表征的学习。作者在四个数据集上进行了对比基准测试(除了 WN18RR 和 FB15k-237 之外,作者还采用了 NELL-995 和 Kinship),本文提出的模型性能相对于目前最先进的算法有显著提高。实际上,这种方法比同一天在 ACL 上提出的方法要好得多。

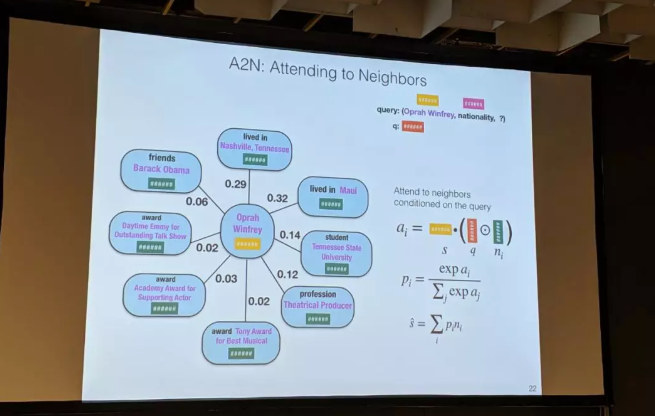

Bansal 等人(https://www.aclweb.org/anthology/P19-1431)提出了 A2N,这是一种具有近邻注意力的知识图谱嵌入技术。聚合来自邻域的消息可以更好地表征作者在模型评价部分展示的多跳关系。在关系预测基准测试中,A2N 的表现与 ConvE 相当或更好。然而,与上述的 Hits@N 和 MRR A2N 方法相比,本文提出的模型则稍微逊色一些。我建议作者比较一下各模型的训练时间和内存开销!

数学预警:Xu 和 Li(https://www.aclweb.org/anthology/P19-1026)的工作与上述两个工作中有些不同,因为他们使用二面体群来建模 KG 嵌入中的关系。本文中的数学相当深奥(读者可以挑战一下自己)。简而言之,二面体组可以对谓词的非阿贝尔成分建模(例如,parent_of o spouse_of != spouse_of o parent_of,其中 o 表示矩阵乘法)。此外,该方法能够建模谓词之间的“对称”和“互逆”关系(就像已经在高级 OWL 本体中一样)。虽然该模型在传统基准对比测试中的表现与 ConvE 相当(因为它们主要由阿贝尔成分构成),但作者构建了一个大量使用非阿贝尔组合的 FAMILY 数据集。这篇论文绝对值得一看,但要做好前期的数学知识储备。

Kutuzov 等人(https://www.aclweb.org/anthology/P19-1325)描述了一种构建图嵌入的框架,他们优化基于图的度量(如最短路径),而不是基于矢量的距离函数,并插入了自定义节点相似度函数,如 Leacock-Chodorow。虽然该方法能加快推理速度,但它不能利用节点特征和边特征,作者声称这是下一步的工作。

Stadelmeier 和 Pado(https://www.aclweb.org/anthology/W19-4816)提出了一个上下文路径模型(CPM),旨在提供传统 KG 嵌入方法之上的可解释性层。作者建议使用两个优化评价分数:路径的修正分数以及三元组和路径之间的相关性分数,即正确信号的强度。

Wang 等人(https://arxiv.org/pdf/1810.07180.pdf)在他们的工作“On Evaluating Embedding Models for Knowledge Base Completion”中说明 KG 嵌入评估中反复出现的问题:他们的预测在逻辑上是否一致?例如,在图中,我们可能会有类似于“Roger 不能与 David 成为朋友”(实例级别)或“人类不能由木头构成”(类级别)这样的规则,这意味着应该考虑 KG 嵌入,并降低此类陈述出现的可能性。作者发现,现在大多数 KG 嵌入模型都会将非零概率值分配给相当不切实际的三元组。

结语

显然,越来越多的人开始对在各种 NLP 领域中应用知识图谱感兴趣。关于 KG 的各种新数据集和任务层出不穷,这很酷!完整的 Oral 报告请参见:http://www.acl2019.org/EN/program.xhtml

原文链接:https://medium.com/@mgalkin/knowledge-graphs-in-natural-language-processing-acl-2019-7a14eb20fce8

技术讨论

技术讨论